Las claves del uso de la Inteligencia Artificial y la ética

Por Florencia Belén Mogno.

En la última década, la inteligencia artificial (IA) dejó de ser un recurso experimental para convertirse en una herramienta cotidiana que incide en el trabajo, la comunicación y hasta en las decisiones más sensibles de gobiernos y empresas.

En ese aspecto, cabe mencionar que este avance acelerado planteó interrogantes éticos que van desde la protección de la privacidad hasta el impacto de los algoritmos en comunidades vulnerables.

El debate ya no se centra únicamente en la capacidad técnica de estas herramientas, sino en cómo garantizar que su uso respete valores universales. La ausencia de controles adecuados puede derivar en prácticas de vigilancia invasivas, sesgos discriminatorios en la selección de personal, manipulación de información, entre otros.

Frente a este panorama, el rol de los organismos internacionales y de las políticas nacionales resulta indispensable para definir límites claros y fomentar el uso seguro de la tecnología. La ética aplicada a la IA se volvió un factor estratégico para prevenir abusos y promover un desarrollo equitativo.

Marcos normativos y guías globales

En relación con el informe consultado, la UNESCO volvió a publicar la “Recomendación sobre la ética de la inteligencia artificial”, el primer marco global que estableció principios para el desarrollo responsable de esta tecnología.

Entre sus pilares, figuran el respeto por los derechos humanos, la transparencia de los sistemas, la supervisión humana y la necesidad de evitar que la IA amplifique desigualdades sociales.

Por otra parte, en 2024, Europa dio un paso más con la aprobación del Reglamento AI Act, la primera ley integral que regula el uso de inteligencia artificial. Esta normativa clasificó los sistemas de acuerdo con su nivel de riesgo, prohibió aquellos que amenazan derechos fundamentales y estableció sanciones para las empresas que no cumplan con los requisitos.

Mientras tanto, el relevamiento facilitado a este medio expuso y destacó que, desde agosto de este año, rigen nuevas disposiciones que abarcan modelos fundacionales y mecanismos de gobernanza.

Estos avances marcaron un hito al reconocer que la innovación tecnológica debe estar acompañada por responsabilidad social. Sin embargo, expertos advirtieron que la cooperación internacional sigue siendo clave, ya que los desafíos superan las fronteras y requieren una respuesta coordinada para ser eficaces.

Sesgos, privacidad y desinformación

Uno de los principales problemas identificados fue el sesgo algorítmico. Los sistemas de IA, al ser entrenados con datos que contienen desigualdades históricas, pueden reproducir y amplificar discriminaciones que afectan especialmente a grupos vulnerables en ámbitos como empleo, justicia y educación.

Otro aspecto crítico es el avance de los contenidos falsos generados por IA, como los deepfakes, que ponen en jaque la confianza pública y exigen no solo regulación, sino también alfabetización digital de la ciudadanía. La recolección masiva de datos también generó preocupaciones por posibles violaciones a la privacidad y el uso indebido de información sensible.

El documento señaló que la construcción de confianza depende de prácticas éticas, auditorías independientes y la implementación de sistemas auditables que permitan a los usuarios saber cuándo interactúan con inteligencia artificial.

Responsabilidad empresarial y cultural

Las organizaciones, tanto públicas como privadas, deben incorporar comités de ética, programas de capacitación y auditorías periódicas para garantizar que el uso de IA respete la normativa vigente. La transparencia en el diseño de algoritmos y el control de los datos recolectados constituyen pasos esenciales para minimizar riesgos.

Además, se recomendó promover la educación digital y la formación en ética tecnológica, de modo que desarrolladores, usuarios y tomadores de decisiones cuenten con herramientas para identificar sesgos, detectar riesgos y actuar en consecuencia.

En ese sentido y para comcluir, el estudio resaltó que este enfoque debe integrarse en una cultura organizacional que priorice los derechos de las personas y reduzca la posibilidad de abusos. Según especialistas, la ética no puede ser un complemento opcional, sino un componente central desde la fase de diseño de cada sistema.

Fuente fotografías: Facebook

"Bodega Gamboa" expande el mapa vitivinícola de la provincia de Buenos Aires

NOTICIAS17 de febrero de 2026

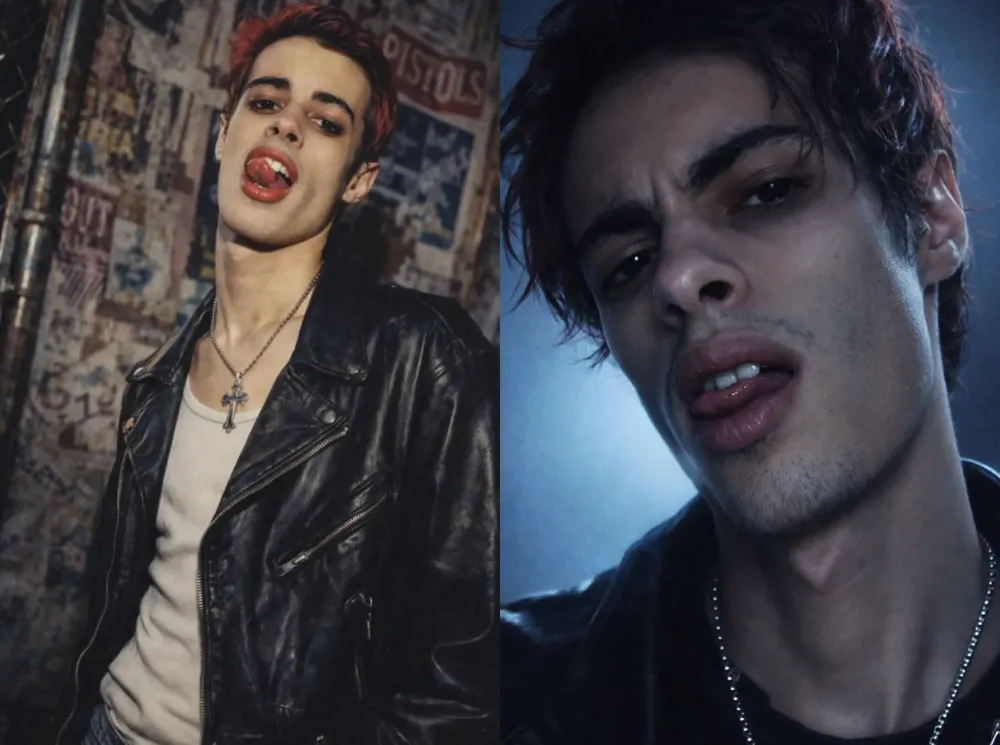

Entre la presencia y la ausencia: Alex Tremo y la pregunta que atraviesa a una generación

NOTICIAS12 de febrero de 2026

El Senado aprobó la reforma laboral de Javier Milei tras una sesión maratónica

NOTICIAS12 de febrero de 2026

"Bodega Gamboa" expande el mapa vitivinícola de la provincia de Buenos Aires

NOTICIAS17 de febrero de 2026

Leo Qüin: la voz que lleva el rock pop a la preadolescencia